箱庭岛随拍AR是一款基于增强现实(AR)技术开发的互动娱乐应用,其核心功能在于将虚拟的二次元角色无缝叠加至用户所处的真实物理环境中,实现实时互动与创意拍摄。软件通过先进的SLAM(即时定位与地图构建)技术、骨骼绑定与动态渲染算法,将来自玛娜希斯回响作品中的角色高精度地锚定在现实场景中,用户可通过智能手机摄像头进行观察、交互并录制富含叙事性的照片与短视频。它不仅是一个拍照工具,更是一个融合了角色养成、故事探索与数字内容创作的综合平台,为二次元文化爱好者提供了深度沉浸式的角色陪伴体验。

箱庭岛随拍AR软件特色介绍

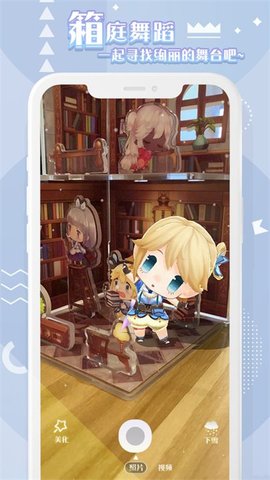

第一,基于混合现实的空间感知与稳定锚定技术。软件并非简单的图像叠加,其底层采用了环境特征点识别与实时三维空间网格重建技术。当用户移动设备时,软件能持续计算虚拟角色相对于现实场景中平面(如桌面、地板)的位置、角度与光照关系,确保角色在视角变换下保持稳定的空间存在感,并能与真实物体产生合理的遮挡关系。这解决了传统AR应用中常见的角色漂移、穿透或光照不协调问题,大幅提升了沉浸感与拍摄成品的真实度。

第二,模块化角色行为与情境交互系统。软件为每位虚拟角色预设了丰富的动作库与情绪状态机,这些行为并非孤立播放,而是能够根据用户触发的简单指令(如点击、手势)或预设的环境逻辑(如识别到特定场景类别)进行动态组合与响应。角色在识别到公园场景时可能自动触发散步或赏花的系列动作,并配合相应的微表情变化。这种基于上下文的情境交互,使得每次互动都具有独特性和叙事潜力,超越了静态摆拍的局限。

第三,多层级角色数据同步与个性化叙事扩展。软件与源IP玛娜希斯回响存在数据联动机制,部分角色状态、装扮或背景故事元素可进行同步或解锁。更重要的是,用户通过日常拍摄积累的时光记录会形成专属的角色互动日志,这些日志可能解锁新的对话、角色背景碎片或特殊装扮。这种设计将单次拍摄行为纳入一个长期的、个性化的角色关系养成体系中,增加了软件的内容深度与用户粘性。

第四,专业级创意工具集的轻量化集成。针对内容创作需求,软件内置了媲美专业软件的核心调节功能,但通过高度优化的交互设计降低了使用门槛。用户可对角色进行六自由度(位置与旋转)的精细调整,实时控制虚拟光源的方向与强度以匹配环境光,并应用基于物理的渲染(PBR)材质效果。在视频录制方面,支持关键帧动画设定、镜头运动路径规划以及简单的后期滤镜与特效叠加,使用户无需借助复杂的外部软件即可完成高质量的AR内容创作。

箱庭岛随拍AR软件功能

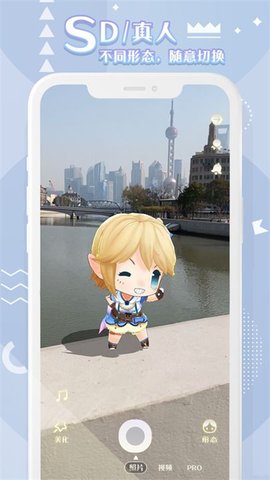

1. 高自由度AR场景构建与拍摄:用户可在任何拥有足够纹理特征的现实环境中,召唤并放置虚拟角色。通过直观的手势控制(如双指缩放、旋转、拖动),可实时调整角色的尺寸、朝向与位置,实现从特写到全景的多种构图。该功能解决了用户希望角色与特定珍贵现实场景(如毕业典礼、旅行地标)合影,但受限于物理条件的核心痛点,实现了随时随地,与心仪角色同框的愿望。

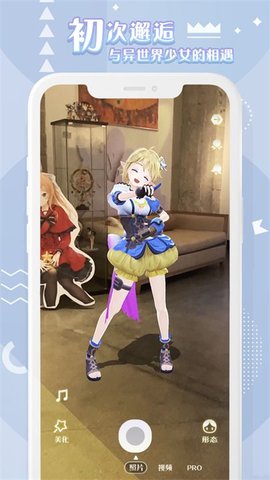

2. 动态姿势与表情管理系统:软件提供庞大的角色动作库,涵盖日常起居、战斗姿态、休闲娱乐等多种类别。表情系统独立于动作,可进行混合搭配,实现微笑奔跑、沉思阅读等复杂状态。用户可通过时间轴编辑器为照片或短视频序列编排连续的动作与表情变化,从而创作出富有故事性的小剧场。此功能直接针对用户创作静态图片时角色表情动作僵化、动态视频叙事困难的问题,提供了从拍照到导演的进阶可能。

3. 虚拟服装与饰品实时换装:提供丰富的角色装扮选项,所有服装和饰品均采用三维建模,支持实时穿着预览与物理模拟(如裙摆晃动、饰品摆动)。部分高级装扮具备特殊的视觉特效或互动反馈。该功能满足了用户对角色的个性化表达需求,通过改变外观来适配不同拍摄主题(如节日、季节),极大地扩展了内容的多样性与重复可玩性。

4. 环境感知与自适应互动:软件的部分高级模式能够利用设备传感器识别简单环境属性,如昼夜时间、天气状况(需联网获取数据)或识别特定的图像标记(Marker)。据此触发角色的专属语音、动作或滤镜效果。在夜间模式下角色可能手持发光道具,识别到书本图案Marker后角色可能做出阅读动作。此功能增强了AR体验的智能感与惊喜元素,让互动不再完全依赖于用户手动操作。

5. 多格式输出与社区分享集成:支持输出高分辨率图片及高清短视频,并提供多种画幅比例选项以适应不同社交平台。软件内集成了一键分享通道,并鼓励用户为作品添加标签、描述,上传至软件内建的创作社区。社区功能不仅限于展示,还包含基于标签的作品发现、灵感借鉴和互动交流,形成了一个从创作到分享、再到获得反馈的闭环,解决了优质AR内容创作后无处展示、缺乏同好交流的社交痛点。

未来前景与技术应用潜力

箱庭岛随拍AR所代表的不仅是单一应用的成功,更指明了消费级AR内容创作工具的未来发展方向。其技术框架与设计理念具有显著的扩展潜力。在技术层面,随着AR硬件(如AR眼镜)的普及,软件的核心交互逻辑可迁移至头戴式设备,实现真正的第一人称视角陪伴体验,虚拟角色将以更具临场感的方式存在于用户的日常生活视野中。人工智能的深度融合将是关键进化方向。通过集成AIGC(人工智能生成内容)技术,未来版本可能实现基于自然语言指令的角色动作生成(如用户说请坐在那边的长椅上并看向夕阳,角色即可自动执行)、根据照片内容智能生成匹配的背景故事文案,甚至实现与角色进行开放式、带有记忆的语音对话,使互动从预设脚本走向高度个性化与智能化。

从应用生态角度看,此类软件有望成为连接IP、创作者与粉丝的新型枢纽。它可以开放部分SDK或创作工具,允许资深用户或同人创作者导入自定义的轻量化3D模型或创作全新的互动剧本,从而形成一个活跃的UGC(用户生成内容)生态。对于IP方而言,这不仅是宣传渠道,更是深度挖掘角色价值、延长IP生命周期的沉浸式平台。从更广阔的视角看,其底层AR空间锚定与交互技术,亦可应用于虚拟试穿、家居布置预览、互动式教育等实用领域,展示了娱乐性应用向工具性、生产力平台演进的可能性。

额外需要说明的是,为确保最佳体验,建议用户在光线充足、纹理清晰的场景下使用本软件,这有助于空间识别算法快速初始化并保持稳定。定期更新软件至最新版本至关重要,开发者将持续优化算法效率、修复已知问题并增加新角色与新功能。对于追求专业级创作的用户,可考虑搭配使用手机外接广角镜头或稳定器,以进一步提升画面质量与拍摄灵活性。软件的成功运营,标志着基于知名IP的、强互动型AR应用正走向成熟,为元宇宙概念下的数字人与现实世界融合提供了具象化的实践案例。